Na začátku ledna 2026 se na sociálních sítích v řadě jazyků – včetně češtiny – začala masově šířit informace, že venezuelský prezident Nicolás Maduro a jeho manželka Cilia Flores byli při americké vojenské operaci v Caracasu zajati a převezeni do Spojených států. Součástí těchto tvrzení bylo i údajné „fotografické“ zachycení momentu Madurova zatčení. Jak však ukázala podrobná analýza agentury AFP, snímek není autentický – byl vytvořen pomocí nástrojů umělé inteligence.

Dezinformace se opírala o falešně připisovaný výrok amerického senátora Mikea Leeho a rychle se šířila na Facebooku i platformě X. Stejný obraz sdíleli i někteří politici v Evropě, přičemž dosah příspěvků šel do statisíců až milionů zhlédnutí. V českém prostředí se obrázek objevoval v příspěvcích a diskusích, které jej přebíraly bez ověření, často s tvrzením, že jde o „důkaz“ amerického zásahu a zatčení venezuelského prezidenta.

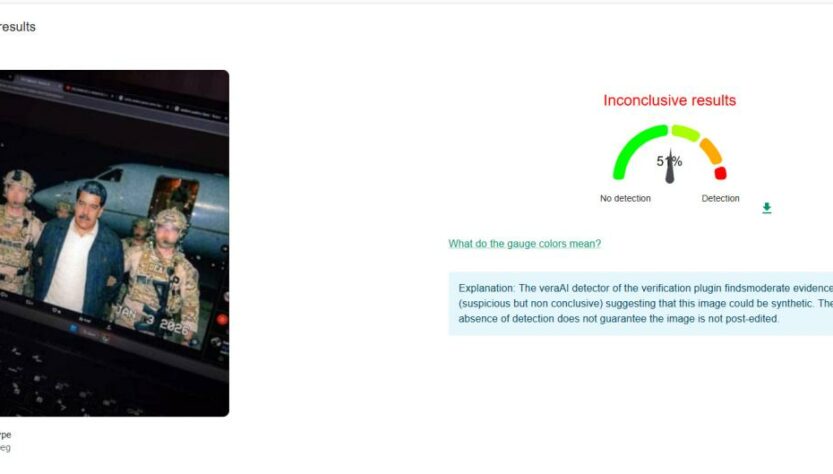

AFP ověřila původ snímku několika metodami. Už samotné reverzní vyhledávání v Googlu ukázalo, že byl obraz vytvořen pomocí nástrojů společnosti Google využívajících umělou inteligenci. Další analýza pomocí technologie SynthID od laboratoře DeepMind potvrdila přítomnost digitálního vodoznaku, který jednoznačně značí, že snímek byl vytvořen nebo upraven pomocí AI. Nezávisle na tom nástroj InVID-WeVerify, vyvíjený mimo jiné ve spolupráci s AFP, vyhodnotil více než padesátiprocentní pravděpodobnost, že jde o uměle generovaný obraz.

Kromě technických analýz upozornili fact-checkeři také na viditelné vizuální nesrovnalosti. Na vestě jednoho z údajných vojáků je například označení americké protidrogové agentury DEA, přestože podle dostupných a důvěryhodných informací měla operaci provádět jednotka Delta Force spadající pod velení JSOC. Tyto rozpory neodpovídají reálnému průběhu podobných vojenských zásahů a jsou typickým znakem obrazů generovaných umělou inteligencí.

Krátce po událostech zveřejnil americký prezident Donald Trump na své síti Truth Social jiný snímek Madura, tentokrát na palubě lodi USS Iwo Jima. Ani tento obraz však nebyl oficiálně potvrzen americkými ani venezuelskými úřady. Ve srovnání s virálně šířenou grafikou se navíc liší vzhled Madura – oblečení i barva vlasů neodpovídají, což dále potvrzuje, že virální „zatýkací“ fotografie není skutečná.

Případ falešného snímku Madura zapadá do širšího trendu, kdy se uměle generované obrazy používají k posilování dramatických politických narativů a k rychlému šíření dezinformací. Stejně jako v Polsku, Španělsku či dalších zemích se tento obsah objevil i v českém online prostoru. Jde o další ukázku toho, že vizuální „důkaz“ na sociálních sítích nemusí být důkazem vůbec – a že bez ověřování zdrojů se umělá inteligence stává silným nástrojem manipulace veřejnosti.